Looking for?

De naleving van de AI Act voor AI-gestuurde medische hulpmiddelen

Inleiding

De integratie van kunstmatige intelligentie (AI) en geavanceerde technologieën in medische hulpmiddelen transformeert de gezondheidszorg met ongekende vooruitgang in diagnostiek, behandelplanning en patiëntbeheer. Innovaties gaande van AI-hulpmiddelen voor beeldanalyse tot geautomatiseerde therapeutische aanbevelingen hebben een enorm potentieel om de resultaten voor patiënten te verbeteren en klinische workflows te optimaliseren. Echter, naarmate het gebruik van AI in medische hulpmiddelen blijft toenemen, neemt ook de complexiteit toe van de regelgeving waarin belanghebbenden wegwijs moeten zijn.

In Europa is de regulering van software met een medisch doel, waaronder AI-gestuurde oplossingen, onderworpen aan de strenge normen die zijn vastgelegd in de Verordening betreffende medische hulpmiddelen (ook wel “Medical Devices Regulation” of MDR genoemd)i en de Verordening betreffende medische hulpmiddelen voor in-vitrodiagnostiek (ook wel “In Vitro Diagnostic Medical Devices Regulation” of IVDR genoemd).ii Deze verordeningen, die volledig van toepassing zijn sinds respectievelijk 26 mei 2021 en 26 mei 2022, stellen strenge eisen aan de evaluatie en het op de markt brengen van dergelijke hulpmiddelen binnen de Europese Unie (EU).

Met de recente goedkeuring van de EU Artificial Intelligence Act (AIA),iii een uitgebreid wetgevingskader dat van toepassing is op alle industriële sectoren, is de regelgeving voor AI aanzienlijk complexer geworden. Onder de AIA kunnen AI-systemen die zijn geïntegreerd in medische hulpmiddelen die onder de MDR en IVDR vallen, worden geclassificeerd als systemen met een hoog risico, wat extra verplichtingen onder de AIA met zich meebrengt.iv Dit creëert een tweeledig regelgevend landschap waarin belanghebbenden moeten navigeren tussen zowel de AI-specifieke vereisten als de gevestigde MDR/IVDR-vereisten.

Nauwkeurig bepalen of uw software classificeert als een AI-systeem onder de AIA is een kritieke stap om te identificeren welke regelgevende voorwaarden gelden en de naleving ervan te garanderen. Verkeerde classificaties kunnen immers leiden tot niet-naleving van verplichtingen of, omgekeerd, tot onnodige regelgevende lasten. Voor een uitgebreid overzicht van de basisprincipes van de AIA, waaronder de belangrijkste definities, het toepassingsgebied en de risicoclassificaties, verwijzen we u naar onze eerdere blogpost over de AIA. Die blogpost biedt meer context en legt de basis voor een beter begrip van de specifieke compliancevereisten die in deze blogpost worden besproken.

Deze blogpost is bedoeld om bruikbare inzichten te bieden voor de naleving van de AIA wanneer je te maken hebt met AI-gestuurde medische hulpmiddelen. We gaan in op de belangrijkste overwegingen om u te helpen wegwijs te geraken in de vereisten van de AIA, zodat uw AI-systemen voldoen aan alle verplichtingen, klaar zijn voor de markt en reeds afgestemd zijn op de zich nog ontwikkelende regelgeving. Het is belangrijk op te merken dat deze blogpost zich beperkt tot AI-systemen die raakvlakken hebben met de MDR en IVDR. We gaan dus niet in op vereisten die specifiek zijn voor MDR/IVDR of op de verplichtingen voor AI-systemen voor algemene doeleinden (ook wel General Purpose AI of GPAI genoemd) of generatieve AI-componenten die bovenop bestaande AI-systemen kunnen worden bestaan. Voor een gedetailleerde bespreking van deze aspecten zijn afzonderlijke, gerichte analyses nodig.

AI-systemen en medische hulpmiddelen met een hoog risico

De AIA deelt AI-systemen in vier op risico gebaseerde categorieën in: onaanvaardbaar risico, hoog risico, beperkt risico en minimaal risico. Deze gelaagde aanpak moet ervoor zorgen dat de regelgevingsdruk in verhouding staat tot de potentiële risico's van het AI-systeem. Voor een meer gedetailleerde uiteenzetting over deze classificaties en hun implicaties raden we aan onze eerdere blogpost te lezen.

AI-systemen met een hoog risico vormen de zwaarst gereguleerde categorie in de AIA omdat ze een aanzienlijk effect kunnen hebben op de gezondheid, de veiligheid en de grondrechten. Artikel 6 van de AIA bevat verschillende criteria voor het bepalen van de “hoog risico”-status door te verwijzen naar bijlage I en bijlage III. Deze blogpost zal zich specifiek richten op Bijlage I, omdat hierin de EU harmonisatiewetgeving wordt beschreven die direct relevant is voor de reikwijdte van deze blogpost - met name AI-systemen die kunnen worden gekwalificeerd als medische hulpmiddelen (ook wel “Medical Devices” of MD's genoemd) of in-vitro diagnostische medische hulpmiddelen (ook wel In “Vitro Diagnostic Medical Devices” of IVD's genoemd) onder de MDR en IVDR.

Criteria voor AI-systemen met een hoog risico gekoppeld aan bijlage I van de AIA

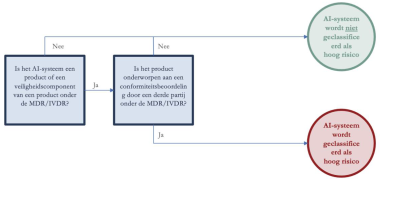

Volgens artikel 6, lid 1, van de AIA wordt een AI-systeem geclassificeerd als een systeem met een hoog risico indien (cumulatieve voorwaarden):

(a) het bedoeld is om te worden gebruikt als veiligheidscomponent van een product of zelf een product is dat valt onder de in bijlage I opgenomen harmonisatiewetgeving van de Unie;; en

(b) het product moet een conformiteitsbeoordeling door een derde partij ondergaan overeenkomstig de EU harmonisatiewetgeving opgenomen in bijlage I. Onderstaande figuurgeeft een visuele leidraad voor de wijze waarop AI-systemen die een link hebben met de MDR/IVDR worden beoordeeld voor classificatie als AI-systeem met een hoog risico in het kader van de AIA. Dit besluitvormingsproces illustreert de toepassing van de criteria van artikel 6, lid 1, specifiek voor AI-systemen die in medische hulpmiddelen zijn geïntegreerd.

De criteria voor “hoog risico” voor AI-gestuurde medische hulpmiddelen onder de AIA in detail

Laten we nu elk criterium bekijken om te begrijpen hoe het specifiek van toepassing is op AI-systemen in het kader van de MDR en de IVDR, zodat duidelijk wordt wanneer deze systemen als hoog risico worden geclassificeerd in het kader van de AIA.

(a) Product of veiligheidscomponent:

▪ Het product zelf: Het AI-systeem kan het primaire medische product zijn, zoals op zichzelf staande AI-software voor diagnostiek, therapeutische aanbevelingen of patiëntbewaking. Voorbeelden hiervan zijn AI-gestuurde tools voor beeldanalyse of software die ondersteuning biedt bij klinische beslissingen.

▪ Veiligheidscomponent: Een andere mogelijkheid is dat het AI-systeem een cruciaal onderdeel is van een medisch hulpmiddel dat de veiligheid en prestaties ervan verbetert. Een AI-algoritme dat is ingebouwd in een hartmonitor en dat waarschuwt bij abnormale metingen, werkt bijvoorbeeld als een veiligheidscomponent omdat het de veiligheid van de patiënt direct beïnvloedt door tijdige interventies mogelijk te maken.

(b) Vereiste van conformiteitsbeoordeling door derden:

Naast het feit dat het AI-systeem een product of veiligheidscomponent moet zijn, moet het ook worden onderworpen aan een conformiteitsbeoordeling door een aangemelde instantie, zoals vereist onder de MDR of IVDR, om te worden geclassificeerd als hoog risico.v Medische hulpmiddelen die onder de MDR worden geclassificeerd als Klasse IIa, IIb en III, en onder de IVDR als Klasse B, C en D, worden in het bijzonder door deze classificatie getroffen vanwege hun inherente risico's voor patiënten. Hoe hoger de classificatie, hoe groter de potentiële impact op de gezondheid van de patiënt en hoe strenger de evaluatie en het toezicht.

Uit het bovenstaande blijkt duidelijk dat de AIA een gerichte aanpak hanteert door alleen AI-systemen die als product of veiligheidscomponent kunnen worden aangemerkt en die aan conformiteitsbeoordelingen door derden worden onderworpen, als AI systemen met een hoog risico te classificeren. Deze aanpak zorgt ervoor dat AI-systemen met significante gevolgen voor de veiligheid en klinische resultaten streng worden beoordeeld en aan de hoogste conformiteitsnormen van de AIA worden onderworpen.

Overzicht van vereisten voor aanbieders van AI-systemen met een hoog risico

Voor AI-gestuurde medische hulpmiddelen die onder de AIA worden geclassificeerd als AI-systemen met een hoog risico, is het essentieel dat wordt voldaan aan de vereisten voor AI-systemen met een hoog risico die in de AIA zijn vastgelegd. Hoewel veel van deze verplichtingen overeenkomen met bestaande MDR/IVDR-normen, zoals het onderhouden van een kwaliteitsmanagementsysteem, het opstellen van gedetailleerde technische documentatie en het geven van duidelijke gebruiksaanwijzingen, introduceert de AIA aanvullende normen die zijn afgestemd op de complexiteit van AI-technologieën. Hieronder volgt een overzicht van enkele van de belangrijkste nalevingsvereisten voor aanbieders van AI-systemen met een hoog risico onder de AIA:

▪ AI-geletterdheid (artikel 4): Aanbieders moeten ervoor zorgen dat hun personeel en operatoren voldoende AI-geletterd zijn, rekening houdend met hun ervaring, opleiding en de context waarin het AI-systeem wordt gebruikt.

▪ Systeem voor risicobeheer (art. 9): Aanbieders moeten een doorlopend risicobeheersysteem opzetten, documenteren en onderhouden gedurende de hele levensduur van het systeem. Dit omvat het identificeren, analyseren en beperken van voorzienbare risico's voor de gezondheid, veiligheid of grondrechten, het uitvoeren van consistente tests en ervoor zorgen dat restrisico's tot een aanvaardbaar niveau worden beperkt door ontwerp, risicobeperkende maatregelen en adequate informatie en training voor gebruikers.

▪ Data en datagovernance (artikel 10): Aanbieders moeten ervoor zorgen dat datasets voor training, validatie en tests voldoen aan strenge kwaliteits- en beheersvereisten, mogelijke vooringenomenheden aanpakken en zich houden aan passende waarborgen, waaronder gegevensbeschermingvereisten, met name bij de verwerking van bijzondere categorieën persoonsgegevens.

▪ Technische documentatie (artikel 11): Aanbieders moeten technische documentatie voor AIsystemen met een hoog risico opstellen voordat ze in de handel worden gebracht en actualiseren, en ervoor zorgen dat deze documentatie aantoont dat aan de wettelijke eisen wordt voldaan en alle essentiële informatie bevat voor de beoordeling, zoals beschreven in bijlage IV van de AIA.

▪ Registratie (artikel 12): Aanbieders moeten ervoor zorgen dat AI-systemen met een hoog risico tijdens hun hele levenscyclus aan automatisch logging doen, zodat gebeurtenissen kunnen worden vastgelegd voor de traceerbaarheid van de werking van het systeem, de identificatie van risico's en de monitoring van de werking na het in de handel brengen. Essentiële logs zijn bijvoorbeeld tijdstempels over het gebruik, controles van input data en personeel dat betrokken is bij resultaatverificatie, indien van toepassing.

▪ Transparantie en informatieverstrekking aan gebruiksverantwoordelijken(art. 13): Aanbieders moeten ervoor zorgen dat systemen zijn ontworpen met het oog op transparantie, zodat gebruikers de output van het systeem kunnen begrijpen en op de juiste manier kunnen gebruiken. Er moeten duidelijke gebruiksinstructies worden verstrekt met gegevens over de aanbieder, de capaciteiten van het systeem, nauwkeurigheid, voorzienbare risico's, maatregelen voor menselijk toezicht, prestatiespecificaties, onderhoudsrichtlijnen en, indien relevant, mechanismen voor logbeheer en -interpretatie.

▪ Menselijk toezicht (art. 14): Aanbieders moeten systemen ontwerpen die effectief menselijk toezicht ondersteunen om risico's met betrekking tot gezondheid, veiligheid of grondrechten te beperken. De toezichtsmaatregelen moeten afgestemd zijn op het risico, de autonomie en de context van het systeem, zodat gebruikers het systeem kunnen begrijpen, monitoren, interpreteren en indien nodig kunnen ingrijpen, bijvoorbeeld door het systeem uit te schakelen of te stoppen. Systemen moeten toezichtsinstrumenten bevatten of faciliteren, zodat de output kan worden gecontroleerd en automatiseringsvooroordelen worden voorkomen.

▪ Nauwkeurigheid, robuustheid en cyberbeveiliging (artikel 15): Aanbieders moeten ervoor zorgen dat AI-systemen met een hoog risico gedurende hun hele levensduur nauwkeurig, robuust en cyberveilig blijven, en bestand tegen fouten en ongeoorloofde wijzigingen. Ze moeten kwetsbaarheden aanpakken, zoals data- of modelvervuiling en aanvallen en bevooroordeelde feedbackloops voorkomen. Aangegeven nauwkeurigheidscriteria moeten worden opgenomen in gebruikersinstructies en technische oplossingen moeten worden afgestemd op risiconiveaus en operationele contexten.

▪ Etiketterings- en toegankelijkheidsvereisten (art. 16): Aanbieders moeten hun naam, handelsgegevens en contactadres vermelden op het AI-systeem met hoog risico, de verpakking of begeleidende documentatie en zorgen voor naleving van de toegankelijkheidsvereisten volgens Richtlijnen (EU) 2016/2102 en (EU) 2019/882.

▪ Systeem voor kwaliteitsbeheer (art. 17): Aanbieders moeten een gedocumenteerd kwaliteitsbeheersysteem opzetten dat naleving van de regelgeving garandeert, onder andere op het gebied van ontwerp, ontwikkeling, gegevensbeheer en risicobeoordeling. Dit systeem moet ook postmarket monitoring, incidentenrapportage en duidelijke communicatieprotocollen met relevante autoriteiten en belanghebbenden omvatten. De reikwijdte en implementatie van het kwaliteitsmanagementsysteem moet in verhouding staan tot de omvang van de organisatie van de aanbieder en kan waar van toepassing worden afgestemd op bestaande sectorale of financiële governancewetten.

▪ Bewaring van documentatie (art. 18): Aanbieders moeten technische documentatie, gegevens over het kwaliteitsbeheersysteem en andere relevante conformiteitsdocumenten bewaren gedurende ten minste 10 jaar nadat het AI-systeem met een hoog risico in de handel is gebracht.

▪ Bewaring van logs (art. 19): Aanbieders moeten logs die automatisch worden gegenereerd door hun AI-systemen met een hoog risico ten minste 6 maanden bewaren of zoals bepaald in toepasselijke Uniewetgevingof nationale wetgeving.

▪ Corrigerende maatregelen en mededelingsverplichting (artikel 20): Aanbieders moeten onmiddellijk corrigerende maatregelen nemen als zij van mening zijn dat een door hen in de handel gebracht AI-systeem met een hoog risico niet aan de verordening voldoet, onder meer door de betrokken partijen in kennis te stellen en zo nodig het systeem uit de handel te nemen of terug te roepen. Als het systeem een risico vormt, moeten de aanbieders de oorzaak onderzoeken, indien van toepassing samenwerken met de gebruiksverantwoordelijke en de markttoezichtautoriteiten en, indien van toepassing, de aangemelde instantie informeren over de niet-conformiteit en de getroffen corrigerende maatregelen.

▪ Samenwerking met autoriteiten (artikel 21): Aanbieders moeten de bevoegde autoriteiten op verzoek alle nodige documentatie en informatie verstrekken om aan te tonen dat hun AIsystemen met een hoog risico aan de eisen voldoen, in een begrijpelijke officiële EU-taal zoals aangegeven door de betrokken lidstaat. Zij moeten ook toegang verlenen tot logs, indien van toepassing en onder hun controle, waarbij de vertrouwelijkheid wordt gehandhaafd overeenkomstig artikel 78.

▪ Aanwijzing van een gemachtigde vertegenwoordiger (art. 22): Aanbieders buiten de EU moeten een gemachtigde vertegenwoordiger in de Unie aanwijzen die verantwoordelijk is voor het controleren van de naleving van de verordening, het ter beschikking houden van documentatie voor autoriteiten en het helpen bij regelgevende maatregelen. Als niet-naleving wordt vastgesteld, moet de vertegenwoordiger het mandaat beëindigen en de relevante autoriteiten op de hoogte stellen.

▪ Conformiteitsbeoordeling, EU-conformiteitsverklaring, CE-markering en registratie (art. 43, 47, 48 en 49): Voordat een AI-systeem in de EU in de handel wordt gebracht of in gebruik wordt genomen, moet een conformiteitsbeoordeling worden afgerond, gevolgd door het opstellen van een EU-conformiteitsverklaring en het aanbrengen van de CE-markering. Het systeem moet ook worden geregistreerd in de EU-database. De AIA staat een uniforme beoordeling toe die zowel de AIA als de MDR/IVDR omvat als de aangemelde instantie gekwalificeerd is voor beide. Anders zijn afzonderlijke beoordelingen nodig, wat kan leiden tot dubbele audits en hogere nalevingskosten. Hoewel vooraf gedefinieerde updates in de oorspronkelijke documentatie geen nieuwe beoordeling vereisen, is voor significante wijzigingen die van invloed zijn op het beoogde doel of het risicoprofiel van het systeem een nieuwe beoordeling nodig. Vanaf 1 augustus 2026 moeten zelfs AI-systemen op die al op de markt zijn, voldoen aan de AIA-eisen als ze aanzienlijke wijzigingen ondergaan.

▪ Monitoring na het in de handel brengen (artikel 72): Aanbieders moeten een monitoringsysteem voor de periode na het in de handel brengen vaststellen en documenteren dat evenredig is aan de aard en de risico's van het AI-systeem en dat de voortdurende naleving waarborgt door tijdens de gehele levensduur van het systeem actief relevante prestatiegegevens te verzamelen en te analyseren. Dit systeem moet worden gebaseerd op een plan voor monitoring na het in de handel brengen dat is opgenomen in de technische documentatie en kan worden geïntegreerd met bestaande monitoringsystemen onder gerelateerde EU-wetgeving om dubbel werk te voorkomen en consistentie te waarborgen.

▪ Melding van ernstige incidenten (artikel 73): Aanbieders moeten ernstige incidenten onmiddellijk melden, risicobeoordelingen uitvoeren, corrigerende maatregelen nemen en meewerken aan onderzoeken zonder het AI-systeem te wijzigen voordat ze de autoriteiten informeren. Meldingen moeten binnen vaste termijnen plaatsvinden, met ruimte voor eerste, onvolledige meldingen. De nationale instanties en de Commissie moeten op de hoogte worden gebracht en de richtsnoeren voor naleving worden tegen augustus 2025 verwacht.

Normen voor AI-systemen met hoog risico

Hoewel de AIA de eisen voor AI-systemen met een hoog risico schetst, is de praktische uitvoering van deze eisen sterk afhankelijk van de ontwikkeling van Europese geharmoniseerde normen. Deze normen vormen de hoeksteen van de AIA en vertalen de wettelijke vereisten naar concrete technische specificaties die in de praktijk kunnen worden toegepast. Deze normen worden ontwikkeld door het Europees Comité voor normalisatie (CEN) en het Europees Comité voor elektrotechnische normalisatie (CENELEC), naar aanleiding van een formeel verzoek tot normalisatie dat in mei 2023 door de Europese Commissie is goedgekeurd.vi Bij het opstellen van deze normen zal niet alleen gebruik worden gemaakt van internationale normen, zoals die van ISO en IEC, maar zullen ook unieke aspecten van de AIA aan bod komen. In tegenstelling tot bestaande internationale inspanningen, zullen de normen onder de AIA prioriteit geven aan risico's voor gezondheid, veiligheid en fundamentele rechten, en niet alleen aan organisatorische doelstellingen.vii Dit omvat specifieke bepalingen voor gegevensbeheer en kwaliteitsmaatregelen op maat om deze risico's te beperken, evenals eisen voor toezichtmechanismen die verifieerbare resultaten opleveren. Deze normen zullen naar verwachting eind april 2025 klaar zijn.viii Na publicatie in het Publicatieblad van de Europese Unie zal naleving van deze normen een 'vermoeden van conformiteit' opleveren, wat betekent dat AI-systemen die aan deze normen voldoen, geacht worden te voldoen aan de eisen van de AIA.ix

Conformiteit van leveranciers voor integratie en gebruik in AI-systemen met hoog risico

De AIA gaat in op de rol van partijen die betrokken zijn bij de levering van AI-systemen, -hulpmiddelen, -diensten, -componenten of -processen die worden gebruikt in of geïntegreerd in AI-systemen met een hoog risico (waaronder AI-systemen die geclassificeerd zijn als medische hulpmiddelen met een hoog risico) en geeft deze partijen ook verantwoordelijkheden.x Deze derden spelen een cruciale rol in de gehele AI-waardeketen door bij te dragen aan modeltraining, hertraining, testen, evaluatie, integratie en andere essentiële aspecten van de ontwikkeling van AI-systemen.xi

Artikel 25, lid 4, bepaalt dat wanneer dergelijke elementen worden geleverd voor integratie in of gebruik in AI-systemen met een hoog risico, er een schriftelijke overeenkomst moet bestaan tussen de leverancier van de elementen en de aanbieder van het AI-systeem met een hoog risico.xii Deze overeenkomst moet de nodige informatie, capaciteiten, technische toegang en andere bijstand specificeren, in overeenstemming met de algemeen erkende stand van de techniek, om de aanbieder in staat te stellen zijn verplichtingen onder de AIA volledig na te komen.xiii Een dergelijke overeenkomst zorgt ervoor dat het AI-systeem met een hoog risico kan voldoen aan kritieke normen van betrouwbaarheid, robuustheid, nauwkeurigheid en transparantie, zoals uiteengezet in de AIA. Om de implementatie van deze vereisten te ondersteunen, kan het AI-bureauvrijwillige modelcontractvoorwaarden ontwikkelen en aanbevelen die ook rekening houden met sectorspecifieke of bedrijfsspecifieke contractuele vereisten. xiv

Voor instrumenten, diensten, onderdelen of processen - met uitzondering van AI-modellen voor algemene doeleinden - die onder een vrije en open source licentie toegankelijk zijn gemaakt voor het publiek, gelden de nalevingsverplichtingen van artikel 25, lid 4, niet.xv De AIA moedigt ontwikkelaars echter sterk aan om algemeen erkende documentatiepraktijken toe te passen, zoals modelkaarten of gegevensbladen.xvi Deze praktijken vergroten de transparantie, bevorderen de samenwerking binnen de AI-waardeketen en zorgen voor een verantwoord gebruik of integratie in AI-systemen met een hoog risico. Door duidelijke en gedetailleerde informatie te verstrekken, zelfs in een open-sourcecontext, dragen ontwikkelaars aanzienlijk bij aan de opbouw van een betrouwbaar AI-ecosysteem en ondersteunen ze de veilige en effectieve inzet van hun bijdragen in toepassingen met een hoog risico.

De wetenschappelijke uitzondering benutten: innovatie met oog voor regelgeving

De AIA voorziet in specifieke vrijstellingen voor AI-systemen die uitsluitend worden ontwikkeld en gebruikt voor wetenschappelijk onderzoek en ontwikkelingxvii , waardoor onderzoekers kunnen innoveren zonder dat ze meteen aan alle regelgeving moeten voldoen. Deze vrijstelling is bedoeld om de wetenschappelijke vrijheid te respecteren en innovatie te ondersteunenxviii , waardoor onderzoekers in academische instellingen, openbare onderzoeksinstellingen of niet-commerciële onderzoeksprojecten dergelijke AI-systemen met meer flexibiliteit kunnen ontwikkelen. Op die manier bevordert de AIA een omgeving waarin experimenten en de snelle ontwikkeling van nieuwe AItoepassingen worden aangemoedigd.

Deze uitzondering is met name van belang voor AI-systemen in wetenschappelijke onderzoeksfasen van de ontwikkeling van medische hulpmiddelen met een hoog risico, of het nu gaat om academische, door de EU gefinancierde of door de privésector gesponsorde projecten. De wetenschappelijke uitzondering heeft echter welomschreven grenzen. Zodra een AI-systeem overgaat van wetenschappelijk onderzoek naar commerciële toepassing of toepassing in de echte wereld, moet het voldoen aan het volledige spectrum van vereisten onder de AIA. Dit omvat scenario's waarbij onderzoeksresultaten worden geïntegreerd in marktrijpe producten, worden aangeboden als diensten of worden ingezet in klinische workflows buiten gecontroleerde onderzoeksomgevingen. Zelfs een gedeeltelijke verschuiving in de richting van commercialisering - zoals het uitbreiden van de toegang tot het hulpmiddel naar anderen dan onderzoeksdeelnemers of het opnemen ervan in praktische toepassingen - maakt de wetenschappelijke uitzondering niet van toepassing en onderwerpt het systeem aan de vereisten van de AIA.

Hoewel de wetenschappelijke uitzondering in eerste instantie dus verlichting biedt op het gebied van regelgeving, is het uiteindelijke doel van de meeste onderzoeksprojecten om de resultaten te realiseren in praktische, commerciële of klinische toepassingen. Door vroegtijdig te anticiperen op wettelijke vereisten, zelfs wanneer ze vallen onder het schild van de wetenschappelijke uitzondering, kunnen onderzoekers aanzienlijke voordelen behalen, zoals een betere marktgereedheid en de mogelijkheid om valkuilen te vermijden die het succes van hun AI-systemen zouden kunnen belemmeren.

Om beter voorbereid te zijn op de toekomstige naleving van de verordening, is het essentieel om al in de onderzoeksfase belangrijke strategieën te integreren. Vanaf het begin moeten ontwikkelaars nadenken over hoe hun AI-systemen zullen voldoen aan de eisen van de AIA om toekomstige wijzigingen tot een minimum te beperken. Het bijhouden van grondige technische documentatie tijdens de onderzoeksfase zal de overgang naar commercieel gebruik vergemakkelijken door de basis te leggen voor conformiteitsbeoordelingen. Bovendien kan een vroegtijdige samenwerking met juridische experten de conformiteitstrajecten verduidelijken, waardoor kostbare aanpassingen achteraf worden vermeden, vertragingen worden beperkt en de markttoegang wordt versneld. Zo’n proactieve benadering zorgt voor een vlottere weg naar commercialisering en afstemming op de regelgeving.

Conclusie

Om wegwijs te raken in de toepassing van de AIA voor AI-gestuurde medische hulpmiddelen, moet je de ingewikkelde vereisten begrijpen en strategisch plannen. Van classificatie als AI-systeem met een hoog risico tot het voldoen aan strenge nalevingsverplichtingen, afstemming op al deze vereisten is de sleutel tot succes.

Hier zijn enkele belangrijke stappen die je als leidraad kunt gebruiken:

▪ Identificeren en classificeren: Bepaal of uw systeem gekwalificeerd moet worden als AIsysteem onder de AIA en bepaal de risicoclassificatie van uw systeem.

▪ Begrijp de vereisten voor naleving van de AIA en ontwerp en documenteer met deze vereisten in gedachten: Identificeer de vereisten voor de naleving van de AIA op basis van de classificatie van uw AI-systeem en integreer deze overwegingen - zoals gegevensbeheer, transparantie, menselijk toezicht, nauwkeurigheid en grondige documentatie - in de ontwerpen ontwikkelingsfasen.

▪ Ga aan de slag met juridische experts: Overleg in een vroeg stadium met juridische experts om de nalevingstrajecten te verduidelijken en op de hoogte te blijven van de evoluerende regelgeving. Dit zorgt ervoor dat uw aanpak effectief is afgestemd op de huidige en toekomstige regelgeving.

▪ Plan met het oog op commercialisatie: Of uw AI-systeem nu wordt ontwikkeld in een onderzoeksomgeving of onder normale ontwikkelingsomstandigheden, anticipeer op de behoeften voor markttoegang en integreer vroegtijdige conformiteitsmaatregelen om transities te vergemakkelijken. Deze vooruitziende blik minimaliseert de noodzaak voor dure aanpassingen achteraf, zorgt ervoor dat het systeem klaar is voor de markt en vergroot de aantrekkingskracht van het systeem op investeerders, regelgevers en eindgebruikers, wat de weg vrijmaakt voor een succesvolle commercialisering.

▪ Werk samen in de waardeketen: Als u AI-systemen, -hulpmiddelen, -diensten, -onderdelen of -processen levert die worden gebruikt in of geïntegreerd in AI-systemen met een hoog risico, evalueer dan de noodzaak van samenwerking met systeemaanbieders om ervoor te zorgen dat wordt voldaan aan de verplichtingen van artikel 25, lid 4. Dit omvat het voorbereiden van de nodige technische informatie en documentatie die een naadloze integratie mogelijk maakt.

Door naleving van de verordening vanaf het begin te integreren, kunnen belanghebbenden het volledige potentieel van AI-gestuurde medische hulpmiddelen benutten en tegelijkertijd voldoen aan de veiligheids-, ethische en wettelijke normen. Met een proactieve en allesomvattende strategie kunnen organisaties vol vertrouwen navigeren door de vereisten van de AIA en transformatieve innovaties efficiënt en verantwoord op de markt brengen.

Nayana Murali, de auteur van dit artikel, is een onderzoeker in het EU-gefinancierde project: AISym4MED. AISym4Med heeft financiering ontvangen van de Europese Unie onder het Horizon Europe Framework Programme, Grant Agreement Nº: 101095387. De opvattingen en meningen vervat in dit artikel zijn echter uitsluitend die van de auteur en komen niet noodzakelijk overeen met die van de Europese Unie of de Europese Commissie. Noch de Europese Unie, noch het European Health and Digital Executive Agency kan hiervoor verantwoordelijk worden gehouden.

Referenties:

i Verordening (EU) 2017/745 van het Europees Parlement en de Raad van 5 april 2017 betreffende medische hulpmiddelen, tot wijziging van Richtlijn 2001/83/EG, Verordening (EG) nr. 178/2002 en Verordening (EG) nr. 1223/2009 van de Raad en tot intrekking van Richtlijn 90/385/EEG en 93/42/EEG van de Raad (MDR) (hier te raadplegen: https://eur-lex.europa.eu/legalcontent/ EN/TXT/?uri=celex%3A32017R0745)

ii Verordening (EU) 2017/746 van het Europees Parlement en de Raad van 5 april 2017 betreffende medische hulpmiddelen voor in-vitrodiagnostiek en tot intrekking van Richtlijn 98/79/EG en Besluit 2010/227/EU van de Commissie (IVDR). (Hier te raadplegen: https://eurlex. europa.eu/eli/reg/2017/746/oj)

iii Verordening (EU) 2024/1689 van het Europees Parlement en de Raad van 13 juni 2024 tot vaststelling van geharmoniseerde regels inzake artificiële intelligentie en tot wijziging van Verordeningen (EG) nr. 300/2008, (EU) nr. 167/2013, (EU) nr. 168/2013, (EU) 2018/858, (EU) 2018/1139 en (EU) 2019/2144 en Richtlijnen 2014/90/EU, (EU) 2016/797 en (EU) 2020/1828 (AIA). (Hier te raadplegen: https://eurlex. europa.eu/eli/reg/2024/1689/oj)

iv Artikel 6, lid 1, gelezen in samenhang met bijlage 1, AIA

v Artikel 6, lid 1, onder b), AIA

vi Commission Implementing Decision on a standardisation request to the European Committee for Standardisation and the European Committee for Electrotechnical Standardisation in support of Union policy on artificial intelligence. (Hier te raadplegen: https://ec.europa.eu/transparency/documentsregister/ detail?ref=C(2023)3215&lang=en)

vii Soler Garrido, J., Fano Yela, D., Panigutti, C., Junklewitz, H., Hamon, R., Evas, T., André, A. and Scalzo, S., Analysis of the preliminary AI standardisation work plan in support of the AI Act, EUR 31518 EN, Publications Office of the European Union, Luxembourg, 2023, ISBN 978-92-68-03924-3, doi:10.2760/5847, JRC132833. (Hier te raadplegen: https://publications.jrc.ec.europa.eu/repository/handle/JRC132833)

viii Commission Implementing Decision of 22 May 2023 on a Standardisation Request to the European Committee for Standardisation and the European Committee for Electrotechnical Standardisation in Support of Union Policy on Artificial Intelligence, Art. 1 C(2023) 3215 (Hier te raadplegen: https://ec.europa.eu/transparency/documents-register/detail?ref=C(2023)…;

ix Artikel 40, AIA

x Artikel 25, lid 4, AIA

xi Overweging 88, AIA

xii Artikel 25, lid 4, AIA

xiii Artikel 25, lid 4, AIA

xiv Artikel 25, lid 4, AIA

xv Artikel 25, lid 4, AIA

xvi Overweging 89, AIA

xvii Artikel 2, lid 2, AIA

xviii Overweging 25, AIA